Finanzen und Philosophie - Wie Multikollinearität in MS-Excel und VBA zu handhaben

- Das Problem mit multicollinearity

In diesem Tutorial werde ich Ihnen zeigen, wie Multikollinearität in MS-Excel wth Hilfe von VBA zu behandeln. Ein Problem, das häufig auftritt (und das ist oft in 101-Statistik Kurse vernachlässigt), während multivariate Regressionsmodelle bauen, ist die so genannte multicollinearity. Dieses Phänomen tritt auf, wenn man versucht, eine Zielvariable auf zwei oder mehrere kreuzkorrelierten Prädiktorvariablen zur Rückbildung und das Regressionsmodell kann dazu führen, in einer oder mehrere der folgenden Weise zu verhalten:

- ein Regressionskoeffizienten, die von großer Bedeutung ist, wenn regressiert verliert seine Bedeutung in dem multivariaten Modell

- die Regressionskoeffizienten Amok: Predictor-Variablen, die auf ihre eigenen sind positiv (negativ) korreliert mit der Zielgröße haben negative (positive) Koeffizienten. Oder wenn Sie hinzufügen oder eine Vorhersage-Variable subtrahieren die Koeffizienten der anderen Einflussvariablen stark schwanken.

- das Regressionsmodell zeigt aufgeblasene Standardfehler für die Koeffizienten.

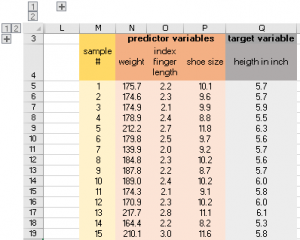

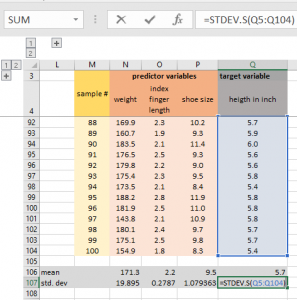

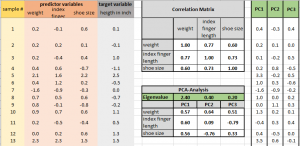

Angenommen, wir folgende Datenmenge von 100 Personen haben:

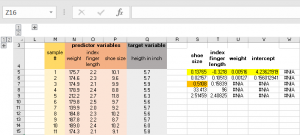

Wir wollen ein Regressionsmodell bauen heigth auf der Basis der Vorhersagevariablen Gewicht, Zeigefinger Länge und Schuhgröße vorherzusagen. Wir wählen daher den Bereich S5: W9, geben Sie die Formel:

und drücken Sie „Shift“ + „Steuerung“ + „Enter“:

Die gelb markierten Zellen unsere Regressionskoeffizienten sind, während die orange markiert Zelle an die r² unseres Modells bezieht.

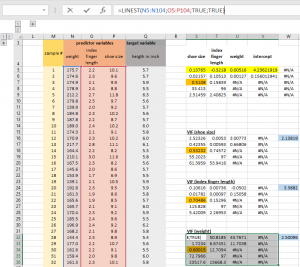

Wir sind nun daran interessiert, zu prüfen, ob unser Regressionsmodell von multicollinearity leidet. Eine Möglichkeit, dies zu tun, ist die so genannte Variance Inflation Factor (VIF) zu berechnen. Wir können eine VIF für jeden unserer drei Prädiktorvariablen berechnen. Um dies zu tun wir jede Prädiktorvariable auf den anderen beiden Prädiktorvariablen zurückbilden und berechnen ihre jeweiligen VIF mit der Formel: 1 / (1-R²).

Die folgende Abbildung zeigt die Berechnung für das VIF (blau hervorgehoben) unserer Prädiktorvariable Gewicht.

Unsere VIFs sind mäßig aufgeblasen (VIF ist 1, wenn die Prädiktorvariablen orthogonal sind, während VIF> 10 in der Regel hoch betrachtet), die wir für den aufgeblasenen VIF in unserem Modell daher berücksichtigen wollen.

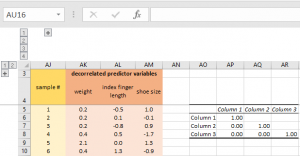

Vor allem wir die Kreuzkorrelation zwischen den Einflussvariablen in einer Korrelationsmatrix zu erfassen haben (Sie können dies entweder mit der Korrelation Merkmale der Daten-Analyse Excel-Add-in oder durch die paarweise Korrelation der Prädiktorvariablen mit der Berechnung Excel-Funktion: Correl) Die Korrelationsmatrix zeigt positive Korrelationen zwischen unseren Prädiktorvariablen:

Bevor wir unsere cholesky Matrix anwenden können, müssen wir zunächst unseren Datensatz standardisieren. Um dies zu tun müssen wir den Mittelwert und Standardabweichung für jeden unserer drei Vorhersage-Spalten berechnen. Zur Berechnung der mittleren wir die Excel-Formel MITTELWERT verwenden, während wir die Standardabweichung mit der Formel berechnen STDEV.S

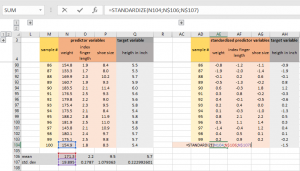

Wir haben dann unsere Prädiktor und Zielvariablen mit der Funktion STANDARDIZE standardisieren:

Lassen Sie uns prüfen, ob es noch Kreuzkorrelation zwischen unseren Einflussvariablen ist. eine zweite Korrelationsanalyse durchführt lässt uns mit einer Identitätskorrelationsmatrix am Ende (d.h. Null Kreuzkorrelation):

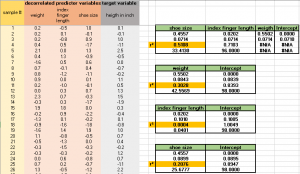

Es gibt einige wichtige Dinge zu nehmen, hier:

- Gewicht als erster Prädiktor erklärt 30% der Varianz in den Zielvariablen und hat einen Regressionskoeffizienten von 0,55, was bedeutet, dass eine Gewichtszunahme von 0,55 Standardabweichungen verursacht eine 1 Standardabweichung Erhöhung unseres Ziel variabler Höhe.

- zusätzlich zu ersten Prädiktorvariable unserer zweite Prädiktor Zeigefinger Länge erklärt 0% der Varianz in den Zielvariablen und hat einen Regressionskoeffizienten von 0,02, was bedeutet, dass eine Erhöhung der Zeigefingerlänge von 0,02 Standardabweichungen eine 1 Standardabweichung Erhöhung bewirkt in unserer Zielgröße Höhe.

- zusätzlich zu ersten und zweiten Prädiktorvariable Schuhgröße erklärt fast 21% der Varianz in der Zielvariablen und hat einen Regressionskoeffizienten von 0,46, was bedeutet, dass eine Erhöhung der Schuhgröße von 0,46 Standardabweichungen in einer 1 Standardabweichung Erhöhung verursacht unserer Zielgröße der Höhe.

3. Deshalb können wir ausdrücken jetzt als die Summe von jedem der r² unserer drei univariaten Regressionen r²: 0,51 = 0,3 + 0 + 0,21. Es ist nun wird auch klar, dass wir den Prädiktor völlig variable Zeigefinger Länge fallen kann, da es so gut wie keine Informationen über unsere Zielgröße enthält.

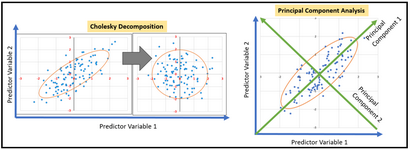

2. Option: Statistische Bleaching Hauptkomponentenanalyse mit

Aus praktischer Sicht ist der große Vorteil von PCA, dass nur durch die wichtigsten Eigenvektoren unter Berücksichtigung (das heißt Hauptkomponenten) können Sie Ihren Merkmalsraum reduzieren (das heißt die Anzahl der Prädiktorvariablen) enorm whith fast keinen Verlust in r². Es ermöglicht auch die Tür für neue Interpretationen eröffnen zugrunde liegenden Mechanismen Verursachung concering die in den jeweiligen Hauptkomponenten erfasst werden. Lassen Sie uns nun in der tatsächlichen Durchführung PCA in Excel vertiefen.

Aufbauend auf unserem exemplarischen multivariate Regressionsmodell von oben kann man wieder die Korrelationsmatrix von Prädiktorvariablen müssen. Um für unsere PCA es zu arbeiten ist wichtig, auch im oberen Dreieck unserer Korrelationsmatrix zu füllen. Nun können wir die Korrelationsmatrix als Bereich an die Matrix-Funktion übergeben

Die Ergebnisse dieser Schritte wie folgt aussehen:

Unsere erste Hauptkomponente hat einen Eigenwert von 2,40, wodurch die Erfassung 2,40 / (2,40 + 0,40 + 0,20) = 80% der Varianz der Eingangsdatenmenge. Die zweite Hauptkomponente erläutert ein zusätzliches 0,40 / (2,40 + 0,40 + 0,20) = 13,4% der Eingangs-Datenvarianz.

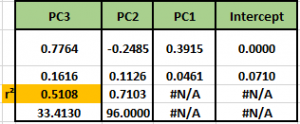

Die 3-Werte unter dem Eigenwerte 2.40 Die sogenannten Beladungen für jede Prädiktorvariable sind, dh die erste Haupt Kombination eine lineare Kombination der Beladungen mit ihrem jeweiligen Proben Wert ist. Der erste Wert der ersten Hauptkomponente ist daher 0,57 * 175,7 + 0,60 * 2,2 + 0,56 * 10,1 = 183,5. Wir wenden dieses Verfahren für alle unsere Proben und auch für die beiden anderen Hauptkomponenten. Dies läßt uns mit einer 100 x 3-Matrix von (unabhängigen / unkorreliert) synthetischen Prädiktorvariablen. Wir haben jetzt unsere Zielvariable „heigth in inch“ (unter Verwendung von Excel inbuild Funktion RGP) auf diese drei Variablen regredieren, die uns mit den folgenden Regressionsergebnis lässt.

Der r² Wert von 0,5108 ist genau die gleiche wie in unserem ursprünglichen multivariate Regressionsmodell. Lassen Sie uns jetzt fallen PKA 2 und 3:

Der erste PC auf seinem eigenen erklärt fast 37% der Varianz in den Zielvariablen. Aber wie können wir PC1 interpretieren. Wenn wir unsere PCA-Tabelle schauen wieder erkennen wir sofort, dass alle Belastungen für PC1 positiv sind. Das bedeutet, dass es positiv auf unsere drei Prädiktorvariablen verbunden ist, die alle ein gewisses Maß an Größe erfassen. Daher konnten wir PC1 als allgemeines Maß der Größe interpretieren, die (natürlich) einen großen Teil der Varianz in unserer Zielgröße heigth erklärt. Wir können jetzt zum Beispiel zeichnen Sie die Regressionsgleichung zwischen PC1 und unserer Zielgröße leicht mit einem 2D-Liniendiagramm.

Hoffentlich werden die Unterschiede zwischen den beiden Ansätzen und deren Umsetzung in diesem Tutorial hinreichend deutlich geworden. Sowohl statistische Aufhellung Techniken verhindern multicollinearity von occuting. Je nach Art des Regressionsproblems und die Aufgabe, die Sie wollen Sie erreichen könnten eine statistische Bleaching-Technik gegenüber dem anderen bevorzugen.

Während die cholesky Bleaching Transformation Sie in dem ursprünglichen Merkmalsraum verläßt und helfen Ihnen, den zusätzlichen jeweiligen Beitrag r² jeden Prädiktorvariablen, PCA zu bewerten - von linear Prädiktorvariablen Kombination - öffnet einen neuen Weg, um einen gemeinsamen Verursachung Mechanismus inhärent in der bis zu finden, Prädiktorvariablen; indem nur die ersten k-Hauptkomponenten unter Berücksichtigung auch PCA ermöglicht es Ihnen, die Anzahl der Prädiktorvariablen enorm zu senken, während nur geringe Mengen an Informationen (r²) in Bezug auf die Zielgröße zu verlieren.